Midjourney interdit les invites avec Joe Biden et Donald Trump, tenant compte des problèmes de désinformation électorale

« Ce truc de modération est plutôt difficile. »

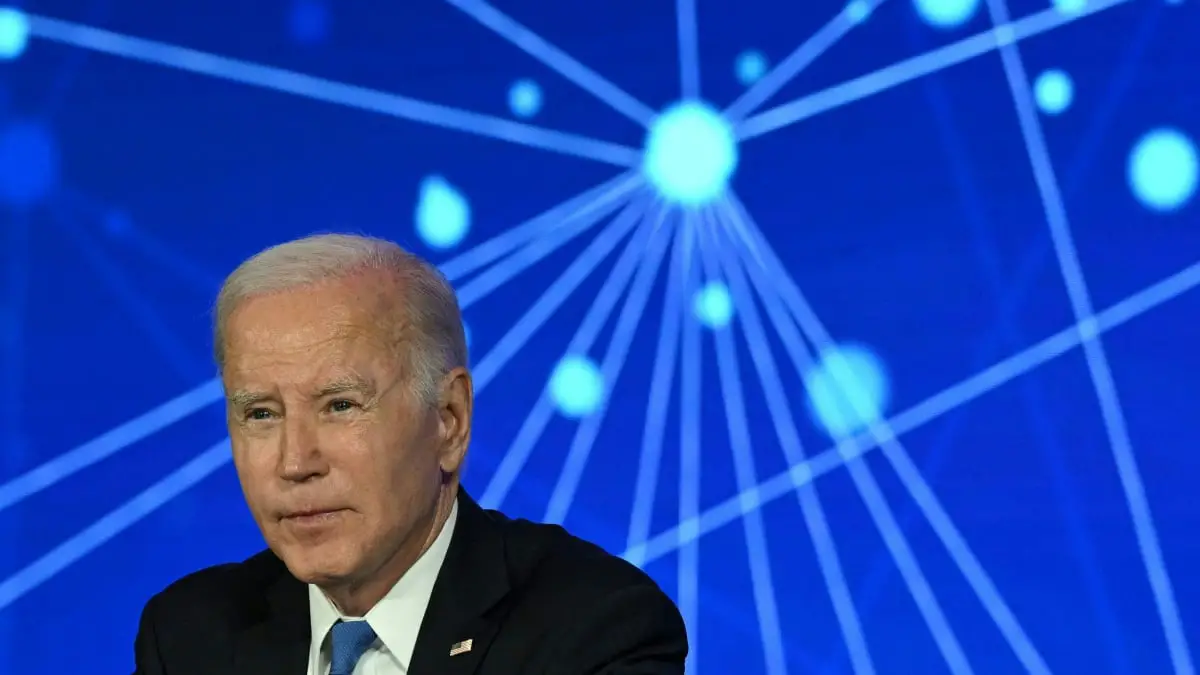

Midjourney, le générateur d’images d’IA connu pour créer de fausses images de l’arrestation de Donald Trump, a interdit les invites d’images incluant le nom du candidat à la présidentielle ainsi que celui de l’actuel président Joe Biden.

Cette décision intervient alors que les experts et les défenseurs mettent en garde contre la crainte que la technologie de l’IA ne soit utilisée pour influencer les électeurs et diffuser des informations erronées à l’approche de l’élection présidentielle de 2024.

Les tests de la nouvelle politique par l’Associated Press Attempts ont montré un avertissement « Invite interdite détectée » pour les demandes d’images de « Trump et Biden se serrant la main sur la plage », a rapporté la publication. D’autres tentatives ont conduit le générateur d’images à avertir les utilisateurs qu’ils avaient « déclenché une alerte d’abus ».

« Je ne me soucie pas vraiment du discours politique. Ce n’est pas le but de Midjourney. Cela ne m’intéresse pas vraiment. Cela dit, je ne veux pas non plus passer tout mon temps à essayer de contrôler le discours politique. Nous sommes donc « Je vais avoir un peu mis le pied dessus », a déclaré David Holz, PDG de Midjourney, lors d’une conférence de presse le 13 mars. Midjourney a lancé l’idée d’interdire de telles invites le mois dernier. Holz a déclaré aux membres de la presse qu’il envisageait une situation encore plus effrayante. La réalité de l’IA en 2028, avec des acteurs malveillants capables de régler plus finement les deepfakes et les chatbots que nous ne pouvons l’imaginer aujourd’hui. À cette fin, a-t-il déclaré, « ce truc de modération est plutôt difficile ».

D’autres outils d’IA générative ont émis des interdictions rapides similaires pour lutter contre la diffusion d’images préoccupantes. L’année dernière, Bing Image Generator de Microsoft a tenté d’interdire les invites contenant l’expression « tours jumelles » afin de freiner la propagation des mèmes mettant en vedette des personnages animés évoquant les attentats du 11 septembre – les créateurs de mèmes, bien sûr, ont trouvé leur solution.

Peu de temps après, le générateur d’images avancé d’OpenAI, DALL-E 3, a été remanié avec des politiques d’utilisation beaucoup plus restrictives, ajoutant un « système de sécurité à plusieurs niveaux » qui limite « la capacité de DALL-E 3 à générer du contenu violent, haineux ou pour adultes ». » a rapporté Chance Townsend de Indigo Buzz. OpenAI a publié des directives spécifiques en matière de désinformation électorale en janvier, notant que DALL-E 3 peut refuser « les demandes qui demandent la génération d’images de personnes réelles, y compris des candidats ».

En février, OpenAI a annoncé avoir détecté et fermé les comptes d’acteurs malveillants affiliés à des États étrangers à l’aide de ses technologies d’IA générative.

Jusqu’à présent, Midjourney, plus laxiste, n’avait pas publié de déclaration ni institué de nouvelles politiques pour lutter contre la désinformation électorale. La plateforme interdit aux utilisateurs de générer des images « ou des campagnes politiques, ou d’essayer d’influencer le résultat d’une élection ». Il s’agit également de l’un des seuls grands fabricants d’images d’IA à ne pas avoir signé un pacte volontaire avec l’industrie s’engageant à adopter des précautions contre la contrefaçon et la désinformation, présenté le mois dernier. L’année dernière, le Center for Countering Digital Hate a signalé que les utilisateurs de Midjourney pouvaient facilement contourner les directives et modérations de la communauté pour générer systématiquement des images conspiratrices et racistes.

Un rapport récent de l’organisation à but non lucratif a testé plusieurs générateurs d’images, dont Midjourney, sur leur capacité à freiner les invites favorisant la désinformation électorale. Les images générées ont réussi à inclure de la désinformation électorale dans 41 % des cas. Midjourney a obtenu les pires résultats parmi tous les outils testés, manquant de désinformation dans 65 % du temps.

« La base de données publique d’images d’IA de Midjourney montre que de mauvais acteurs utilisent déjà l’outil pour produire des images qui pourraient soutenir la désinformation électorale », a prévenu le centre.