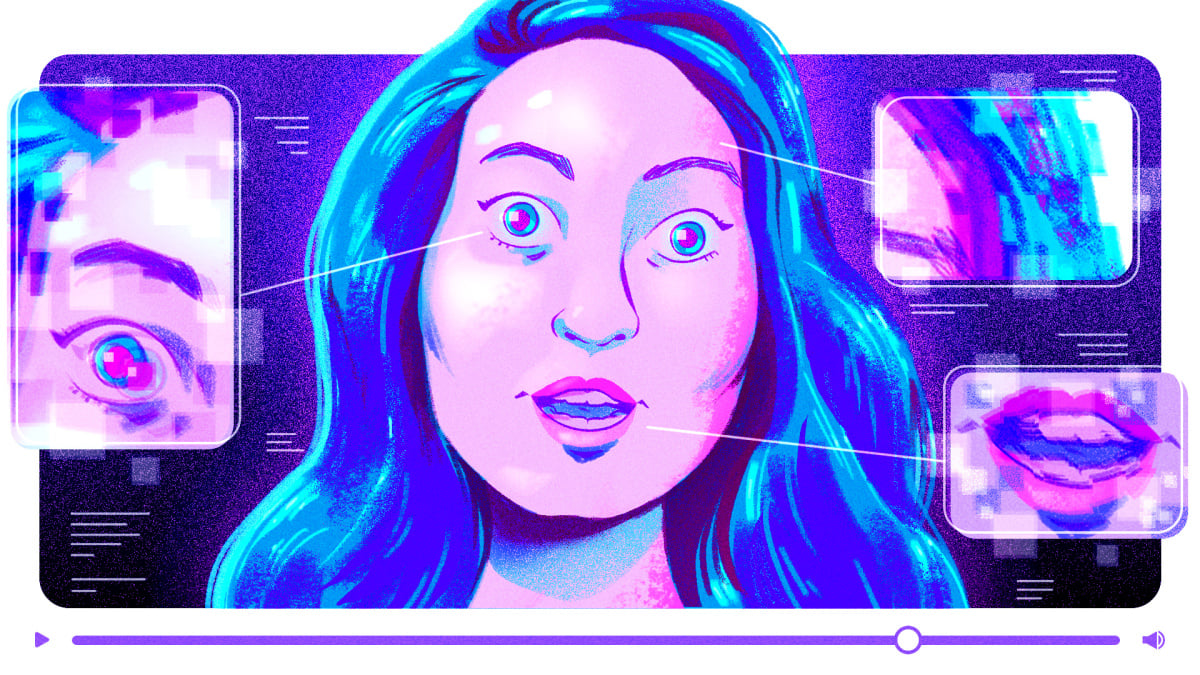

Comment identifier les vidéos générées par l'IA

Tout est question de connaissances en IA.

Désolé de vous décevoir, mais si vous recherchez une liste rapide de moyens facilement identifiables et infaillibles pour détecter les vidéos générées par l'IA, vous ne la trouverez pas ici. L’époque où AI Will Smith mangeait des spaghettis de manière grotesque est révolue. Nous disposons désormais d’outils capables de créer des vidéos convaincantes et photoréalistes en quelques clics.

À l’heure actuelle, les vidéos générées par l’IA sont encore une modalité relativement naissante par rapport au texte, aux images et à l’audio générés par l’IA, car obtenir tous les détails est un défi qui nécessite beaucoup de données de haute qualité. « Mais il n'y a aucun obstacle fondamental à l'obtention de données de meilleure qualité », seulement un travail à forte intensité de main d'œuvre, a déclaré Siwei Lyu, professeur d'informatique et d'ingénierie à l'Université de Buffalo SUNY.

Cela signifie que vous pouvez vous attendre à ce que les vidéos générées par l’IA s’améliorent très bientôt et suppriment les artefacts révélateurs – défauts ou inexactitudes – comme les visages transformés et les objets qui changent de forme qui marquent les créations actuelles de l’IA. La clé pour identifier les vidéos générées par l’IA (ou toute modalité d’IA) réside donc dans la maîtrise de l’IA. « Comprendre que (les technologies d'IA) se développent et avoir cette idée centrale selon laquelle 'quelque chose que je vois pourrait être généré par l'IA' est plus important que, disons, des signaux individuels », a déclaré Lyu, directeur du Media Forensic de l'UB. Laboratoire.

Le tweet a peut-être été supprimé

Naviguer sur le Web infesté d’IA nécessite d’utiliser votre sens du Web et votre bon jugement pour reconnaître quand quelque chose pourrait ne pas fonctionner. C'est votre meilleure défense contre les tromperies de l'IA, la désinformation ou tout simplement les déchets de mauvaise qualité. C'est une compétence difficile à développer, car tous les aspects du monde en ligne luttent contre elle pour attirer votre attention. Mais la bonne nouvelle est qu’il est possible d’affiner vos instincts de détection d’IA.

« En étudiant (les images générées par l'IA), nous pensons que les gens peuvent améliorer leurs connaissances en IA », a déclaré Negar Kamali, chercheur en IA à la Kellogg School of Management de l'Université Northwestern, qui a co-écrit un guide pour identifier les images générées par l'IA. « Même si je ne vois aucun artefact (indiquant une génération d'IA), mon cerveau pense immédiatement : 'Oh, quelque chose ne va pas' », a ajouté Kamali, qui a étudié des milliers d'images générées par l'IA. « Même si je ne trouve pas l'artefact, je ne peux pas dire avec certitude qu'il est réel, et c'est ce que nous voulons. »

À surveiller : vidéos imposteuses et vidéos texte-image

Avant de pouvoir identifier les vidéos générées par l’IA, nous devons distinguer les différents types. Les vidéos générées par l'IA sont généralement divisées en deux catégories différentes : les vidéos imposteuses et les vidéos générées par un modèle de diffusion texte-image.

Vidéos d'imposteur

Il s'agit de vidéos éditées par l'IA qui consistent en un échange de visages – où le visage entier d'une personne est remplacé par celui de quelqu'un d'autre (généralement une célébrité ou un homme politique) et fait dire quelque chose de faux – et en une synchronisation labiale – où la bouche d'une personne est subtilement manipulée et remplacée. avec un son différent.

Les vidéos imposteuses sont généralement assez convaincantes, car la technologie existe depuis plus longtemps et elles s'appuient sur des séquences existantes au lieu de générer quelque chose à partir de zéro. Vous vous souvenez de ces vidéos deepfake de Tom Cruise d'il y a quelques années qui sont devenues virales parce qu'elles étaient si convaincantes ? Ils ont travaillé parce que le créateur, Chris Ume, ressemblait beaucoup à Tom Cruise, a travaillé avec un imitateur professionnel de Tom Cruise et a effectué de nombreux montages minutieux, selon une interview avec Ume de The Verge. De nos jours, il existe une multitude d’applications qui accomplissent la même chose et peuvent même – de manière terrifiante – inclure l’audio d’un court extrait sonore que le créateur trouve en ligne.

Cela dit, il y a certaines choses à rechercher si vous soupçonnez un deepfake vidéo AI. Tout d’abord, regardez le format de la vidéo. Les deepfakes vidéo IA sont généralement « filmés » dans un format de tête parlante, où vous pouvez simplement voir la tête et les épaules de l'orateur, avec ses bras hors de vue (nous en parlerons plus dans une minute).

Pour identifier les échanges de visage, recherchez des défauts ou des artefacts autour des limites du visage. « Vous voyez généralement des artefacts lorsque la tête se déplace obliquement par rapport à la caméra », a déclaré Hany Farid, expert en criminalistique numérique et professeur d'informatique à l'UC Berkeley. Quant aux bras et aux mains, « Si la main bouge ou si quelque chose obstrue le visage, (l'image) aura un petit problème », a poursuivi Farid. Et surveillez les bras et le corps pour détecter les mouvements naturels. « Si tout ce que vous voyez c'est ça », – lors de notre appel Zoom, Farid garde les bras raides et à ses côtés – « et que la personne ne bouge pas du tout, c'est faux. »

Si vous soupçonnez une synchronisation labiale, concentrez votre attention sur la bouche du sujet, en particulier sur les dents. Avec les contrefaçons, « nous avons vu des gens qui avaient des dents de forme irrégulière », ou le nombre de dents changer tout au long de la vidéo, a déclaré Lyu. Un autre signe étrange à surveiller est « l’oscillation de la moitié inférieure » du visage, a déclaré Lyu. « Il existe une procédure technique qui consiste à faire correspondre exactement le visage de cette personne », a-t-il déclaré. « Pendant que je parle, je bouge beaucoup mon visage, et cet alignement, si vous avez juste un peu d'imprécision, les yeux humains sont capables de le dire. » Cela donne à la moitié inférieure du visage un effet plus liquide et caoutchouteux.

Le tweet a peut-être été supprimé

En ce qui concerne les deepfakes d'IA, Aruna Sankaranarayanan, assistante de recherche au laboratoire d'informatique et d'intelligence artificielle du MIT, affirme que sa plus grande préoccupation ne concerne pas les deepfakes des hommes politiques les plus célèbres du monde comme Donald Trump ou Joe Biden, mais ceux de personnalités importantes qui n'est peut-être pas aussi connu. « La fabrication de leur part, déformant certains faits, quand on ne sait pas à quoi ils ressemblent ou à quoi ils ressemblent la plupart du temps, c'est vraiment difficile à réfuter », a déclaré Sankaranarayanan, dont le travail se concentre sur les deepfakes politiques. Encore une fois, c’est à ce moment-là que la maîtrise de l’IA entre en jeu ; des vidéos comme celles-ci nécessitent des recherches pour être vérifiées ou démystifiées.

Vidéos texte-image

Ensuite, il y a les nouveaux venus sexy : les modèles de diffusion texte-image qui génèrent des vidéos à partir d’invites de texte ou d’images. OpenAI a fait sensation en annonçant Sora, son générateur vidéo IA. Bien qu'elles ne soient pas encore disponibles, les vidéos de démonstration ont suffi à étonner les gens avec leurs détails méticuleux, leur photoréalisme éclatant et leur suivi fluide, le tout prétendument à partir de simples invites textuelles.

Depuis lors, de nombreuses autres applications sont apparues qui peuvent transformer vos mèmes préférés en GIF et en scènes imaginatives qui semblent avoir nécessité toute une équipe CGI avec un budget Disney. Les créateurs hollywoodiens ont raison d’être indignés par l’avènement des modèles de synthèse texte-image, qui se sont probablement formés sur leur travail et menacent désormais de le remplacer.

Le tweet a peut-être été supprimé

Mais la technologie n'est pas encore là, car même ces vidéos Sora ont probablement nécessité un montage astucieux et fastidieux. Les vidéos de démonstration de Sora consistent en une série de montages rapides, car la technologie n'est pas encore assez performante pour créer des vidéos plus longues et impeccables. Il faut donc être particulièrement attentif aux clips courts : « Si la vidéo dure 10 secondes, méfiez-vous. Il y a une raison pour laquelle elle est courte », a déclaré Farid. « Fondamentalement, le texte vers vidéo ne peut tout simplement pas faire un seul montage d'une minute », a-t-il poursuivi, tout en ajoutant que cela devrait s'améliorer au cours des six prochains mois.

Le tweet a peut-être été supprimé

Farid a également conseillé de faire attention aux « incohérences temporelles », telles que « le bâtiment a ajouté un étage ou la voiture a changé de couleur, des choses qui ne sont physiquement pas possibles », a-t-il déclaré. « Et souvent, c'est loin du centre de l'attention que cela se produit. » Alors, concentrez-vous sur les détails du contexte. Vous pourriez voir des objets anormalement lisses ou déformés, ou la taille d'une personne changer lorsqu'elle se promène dans un bâtiment, a déclaré Lyu.

Le tweet a peut-être été supprimé

Kamali dit de rechercher des « invraisemblances socioculturelles » ou des indices contextuels là où la réalité de la situation ne semble pas plausible. « Vous ne voyez pas immédiatement les indices, mais vous sentez que quelque chose ne va pas – comme une image de Biden et Obama portant des costumes roses », ou le pape dans une doudoune Balenciaga.

Mis à part les indices contextuels, l’existence d’artefacts va probablement diminuer très bientôt. Et Wall Street est prêt à parier des milliards de dollars là-dessus. (Cela dit, le capital-risque n’est pas vraiment connu pour ses valorisations raisonnables des startups technologiques basées sur des preuves solides de rentabilité.)

Les artefacts peuvent changer, mais le bon jugement demeure.

Comme Farid l'a dit à Indigo Buzz : « Viens me parler dans six mois, et l'histoire aura changé. » Ainsi, s’appuyer sur certains indices pour vérifier si une vidéo est générée par l’IA pourrait vous causer des ennuis.

L'article de Lyu de 2018 sur la détection des vidéos générées par l'IA parce que les sujets ne clignent pas correctement des yeux a été largement diffusé dans la communauté de l'IA. En conséquence, les gens ont commencé à rechercher des défauts de clignement des yeux, mais à mesure que la technologie progressait, des clignements plus naturels ont également progressé. « Les gens ont commencé à penser que s'il y avait un bon clignement des yeux, il ne devait pas s'agir d'un deepfake et c'était là le danger », a déclaré Lyu. « Nous voulons en fait sensibiliser l'opinion, mais pas nous accrocher à des artefacts particuliers, car ces artefacts vont être modifiés. »

Faire prendre conscience que quelque chose pourrait être généré par l'IA « déclenchera toute une séquence d'action », a déclaré Lyu. « Vérifiez, qui partage cela ? Cette personne est-elle fiable ? Existe-t-il d'autres sources corrélées à la même histoire, et cela a-t-il été vérifié par d'autres moyens ? Je pense que ce sont les mesures les plus efficaces contre les deepfakes. »

Le tweet a peut-être été supprimé

Pour Farid, l’identification des vidéos générées par l’IA et des deepfakes trompeurs commence par l’origine de vos informations. Prenez les images générées par l’IA qui ont circulé sur les réseaux sociaux à la suite des ouragans Helene et Milton. La plupart d’entre eux étaient manifestement faux, mais ils avaient quand même un effet émotionnel sur les gens. « Même lorsque ces choses ne sont pas très bonnes, cela ne veut pas dire qu'elles ne pénètrent pas, cela ne veut pas dire que cela n'a pas d'impact sur la façon dont les gens absorbent l'information », a-t-il déclaré.

Le tweet a peut-être été supprimé

Soyez prudent lorsque vous recevez vos nouvelles sur les réseaux sociaux. « Si l'image ressemble à un clickbait, c'est un clickbait », a déclaré Farid avant d'ajouter que tout dépend de l'éducation aux médias. Pensez à qui a posté la vidéo et pourquoi elle a été créée. « Vous ne pouvez pas simplement regarder quelque chose sur Twitter et dire : 'Oh, ça doit être vrai, laissez-moi le partager.' »

Si vous avez des doutes sur le contenu généré par l'IA, vérifiez d'autres sources pour voir si elles le partagent également et si tout se ressemble. Comme le dit Lyu, « un deepfake ne semble réel que sous un seul angle ». Recherchez d'autres angles de l'instance en question. Farid recommande des sites comme Snopes et Politifact, qui démystifient la désinformation et la désinformation. Alors que nous continuons tous à naviguer dans le paysage de l’IA en évolution rapide, il sera crucial de faire le travail et de faire confiance à votre instinct.